工作六年,我总结了一份数据产品建设指南 打造高效数据处理服务

在数据驱动的时代,数据处理服务作为数据产品建设的核心支撑,其设计与实施直接关系到数据产品的成败。基于六年的行业实践经验,我了这份数据产品建设指南,聚焦于数据处理服务的关键环节,旨在为从业者提供一套系统、可落地的参考框架。

一、数据处理服务的核心价值:从“成本中心”到“价值引擎”

数据处理服务不应被视为单纯的技术支持或成本中心,而应定位为驱动业务决策与创新的价值引擎。它通过高效、准确的数据加工、整合与供给,赋能数据分析、用户画像、智能推荐等上层应用,最终实现数据资产的价值变现。

二、数据处理服务建设四步法

1. 需求梳理与目标定义

- 明确业务场景:深入理解数据服务将支撑的具体业务场景,如实时监控、离线报表、A/B测试等。

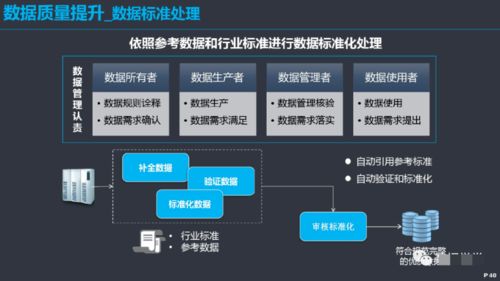

- 定义数据标准:建立统一的数据口径、数据质量标准和数据安全规范,确保数据的一致性与可信度。

- 设定性能指标:根据场景要求,确定数据处理的速度(实时/准实时/批处理)、吞吐量、稳定性(SLA)等关键指标。

2. 架构设计与技术选型

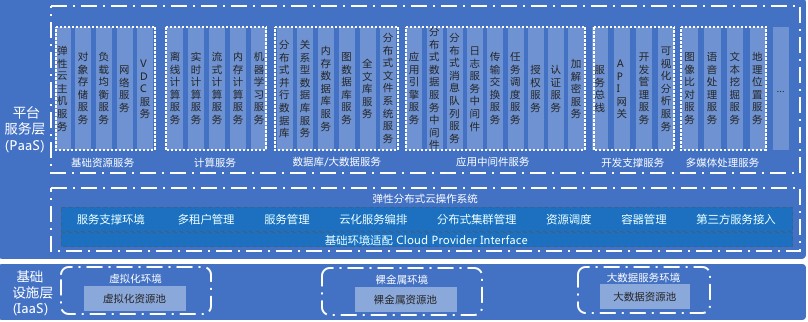

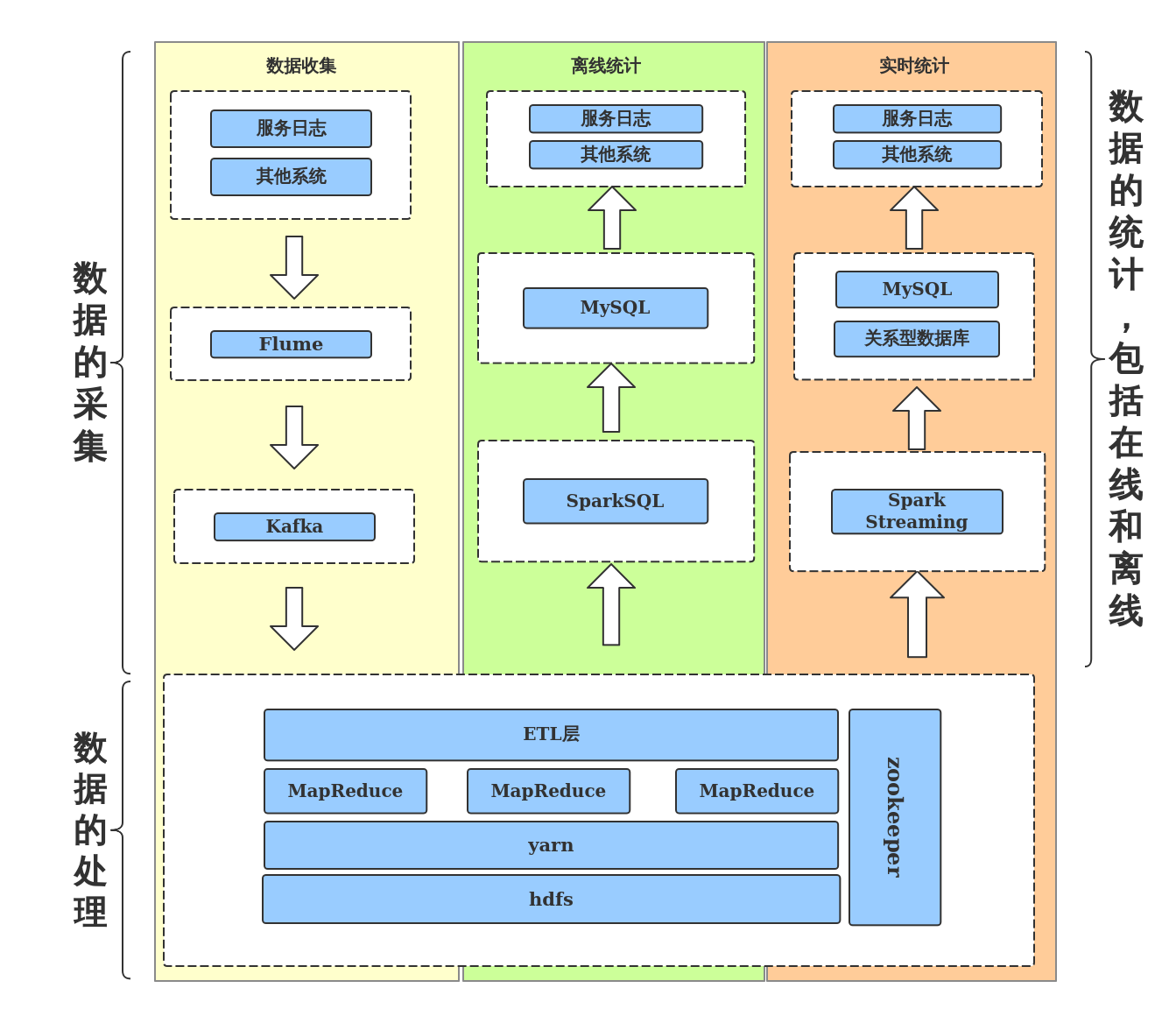

- 分层架构设计:通常采用“数据采集→存储→计算→服务”的分层架构,确保各层解耦、易于扩展。

- 技术栈选择:

- 采集层:根据数据源类型(日志、数据库、API等)选择Flume、Kafka、Sqoop等工具。

- 存储层:结合数据热度与查询需求,采用数据湖(如HDFS、S3)、数据仓库(如Hive、Redshift)或实时数据库(如ClickHouse、Druid)。

- 计算层:批处理可选Spark、Hive;流处理可选Flink、Storm;混合计算可考虑Flink+Iceberg等架构。

- 服务层:通过API、数据服务中间件或数据产品平台对外提供数据服务。

- 成本与效能平衡:在满足性能的前提下,综合考虑技术团队的熟悉度、运维成本与长期可维护性。

3. 实施开发与质量保障

- 迭代开发:采用敏捷开发模式,优先实现核心数据管道与关键数据模型,快速验证价值。

- 数据质量监控:建立数据质量监控体系,通过规则校验(如完整性、一致性、及时性)及时发现问题并告警。

- 测试与验证:对数据处理逻辑进行单元测试、集成测试,确保数据转换的准确性;对数据服务接口进行压力测试,保证性能达标。

4. 运维优化与持续演进

- 自动化运维:实现数据任务的调度监控、故障自愈、资源弹性伸缩,降低人工干预成本。

- 性能优化:定期分析数据管道瓶颈,通过优化SQL、调整资源配置、数据分区索引等手段提升效率。

- 服务治理:建立数据服务目录、元数据管理、数据血缘追踪,提升数据可发现性与可管理性。

- 持续迭代:紧跟业务变化与技术趋势,不断优化数据处理逻辑与服务方式,如引入机器学习进行数据质量自动修复。

三、关键挑战与应对策略

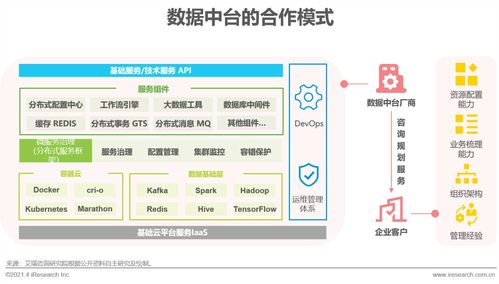

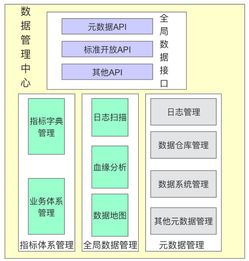

- 数据孤岛与整合难题:推动企业级数据中台建设,建立统一的数据模型与接入规范。

- 实时处理与成本压力:采用Lambda或Kappa架构平衡实时与批处理需求;利用云原生技术的弹性控制成本。

- 数据安全与合规:实施数据分级分类、访问权限控制、数据脱敏加密,并满足GDPR等法规要求。

- 跨团队协作障碍:建立包含业务、数据、研发、运维的虚拟团队,明确职责与协作流程。

四、以服务思维驱动数据价值

数据处理服务的建设并非一蹴而就,而是一个持续迭代、不断贴近业务的过程。核心在于树立“服务思维”——以稳定、高效、易用的数据供给为目标,通过标准化的流程、可靠的技术架构和主动的运营优化,将数据真正转化为业务增长的助推器。这份指南源于实践,也将在实践中不断进化,希望为您的数据产品建设之路提供一份有价值的参考。

如若转载,请注明出处:http://www.smnxr.com/product/24.html

更新时间:2026-06-02 00:36:07